Realismo Algorítmico

Esse é nossa parte 3 da série sobre ética e IA. Se você ainda não viu a 1ª e a 2ª parte, eu indico fortemente que clique aqui para poder compreender melhor esse texto. Se já leu os outros, aqui abordaremos Ética nas IAs, e como isso infere na comunidade global.

Do Estudo

Em Algorithms and Institutions, 3 brasileiros escreveram como as ciências sociais podem contribuir com governança algorítmica.

Algoritmo é uma forma abstrata que formaliza a descrição computacional, e as interliga a outros computadores, como data, estruturas de data, programas, e processos.

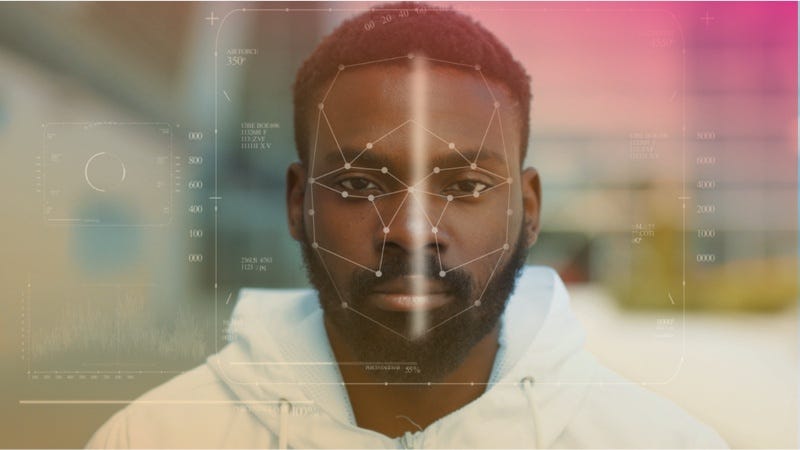

Como abordado na 2ª parte dessa série, os algoritmos facilitam a vida das pessoas, diminuindo a necessidade delas de fazerem atividades mais manuais. Contudo, assim como eles podem auxiliar os humanos, também geram discriminação e marginalização de pessoas quando tomam decisões erradas eticamente.

O Que é Governança?

Alguns chamam de Governança Algorítmica, outros de algocracia (uma forma de governo dos algorítmos). No fim, é uma evolução na forma de execução de poder, em que o controle é exercido pelos computadores e por quem os administra.

Aneesh (2009), afirma que a algocracia seria a arte de conduzir condutas de ferramentas tecnológicas na manipulação desse “saber algorítmico”.

Já Floridi (que foi base para nosso 2º artigo aqui da série), afirma que a governança pode ser vista como uma “prática de estabelecer e implementar políticas, procedimentos, e limites para um desenvolvimento ético e moral”.

A pergunta que vem à mente de todos é: podemos modificar a política tradicional através dessas IAs? Será que essas solucionarão problemas que temos atualmente? Ou elas os propagarão?

Algoritmos como instituições são instrumentos que realizam um tipo de decisão para resolver um problema. Quando pensamos em pensamento algorítmico como instituições, nós compreendemos que existe uma certa capacidade que pode estruturar o comportamento humano, e afetar as nossas escolhas. Isso pode ser visto em diversos casos, como o das eleições dos Estados Unidos de 2016.

Implicações Práticas

As IAs podem ser utilizadas para prever coisas boas, ou podem ter vieses. É de suma importância ter um sistema de design prévio, como o privacy by design, que irá orientar os desenvolvedores sobre como seguir a ética e a moral.

Claro que é importante que o próprio desenvolvedor tenha um pensamento crítico e um senso reflexivo, todavia, se existir alguma norma/regulamento/ISO, pode facilitar e muito essa implementação.

Um exemplo clássico é o sistema de score social da China, o qual obviamente é imoral ou, pelo menos, amoral para muitos ocidentais. Ele é um sistema de ranking comunitário da população chinesa que não somente infere no poder econômico do indivíduo, como também controla os seus indivíduos.

Tá, mas e essa algocracia é boa?

Bem, ter uma IA que detém o poder de controlar a sociedade pode gerar um sistema de “casta” como o rankeamento social chinês, já que, o algoritmo fará uma leitura generalizada da vida da pessoa. O problema todo está nos vieses e implicações discriminatórias que podem ocorrer. Dado isto, o melhor seria ter um código de moral ou conduta de cada empresa, baseado nos valores e nas missões da companhia, que orientassem os desenvolvedores objetivando mitigar ações parciais.

Siga-me aqui na Prensa e entre no meu grupo do Telegram para não perder as novidades.

Este artigo foi escrito por Maria Renata Gois e publicado originalmente em Prensa.li.